Les générateurs d’images par IA tels que DALL-E, Midjourney ou encore Stable Diffusion sont aujourd’hui capables de créer des photos très réalistes. Cette émergence de l’intelligence artificielle remet en question la fiabilité des images et renforce la nécessité du fact checking. Comment agir face au nombre considérable d’images qui se présentent à nous ? Comment distinguer une vraie photographie d’une fausse ? Voici nos astuces pour détecter les images générées par IA et éviter les fake news.

Les IA génératives évoluant très vite, il est fort possible que les points mentionnés dans ce dossier ne reflètent rapidement plus l’état de l’art en termes de détection des défauts d’une IA. Nous tâcherons de mettre régulièrement à jour cet article.

Sommaire

- L’image à l’heure des réseaux sociaux et des IA

- Comment les IA « fabriquent-elles » une image ?

- Observer les détails des images pour y déceler des incohérences

- L’importance du décor dans une photo

- Opter pour un regard photographique

- Midjourney, Dall-E, Stable Diffusion : ne plus simplement croire ce que l’on voit

L’image à l’heure des réseaux sociaux et des IA

Alors que les formes de désinformation et de manipulation ne cessent de se multiplier – notamment depuis l’adoption en masse des réseaux sociaux –, vérifier l’information qui se présente à nous est essentiel. En effet, nous vivons aujourd’hui à l’ère de la « surinformation », dans lequel tout le monde a la possibilité de créer ou relayer une information. Il devient également de plus en plus complexe de démêler le vrai du faux.

Les images, les vidéos ou les photographies avaient jusqu’alors un rôle de témoignage. C’est en partant de ce postulat que le métier de photoreporter s’est répandu, afin de transmettre la vérité et l’information issue du terrain, à travers des images marquantes, qui pouvaient difficilement être contestées.

Mais aujourd’hui, les progrès fulgurants des IA génératives (Midjourney, Dall-E, Stable Diffusion, etc.) sont tels qu’il sera bientôt impossible de distinguer une « vraie » photo d’une « fausse« . Or, ajouter cela à un monde où l’information est déjà défaillante serait nous pousser vers la désinformation massive. Face à cela, deux risques se présentent : soit plus personne ne croira les médias, soit les fausses informations règneront – ce qui dans les deux cas constituera un danger pour notre société.

Il est donc essentiel d’entrainer notre esprit critique et notre discernement dès maintenant, afin de ne pas tomber dans les pièges de la désinformation.

Comment les IA « fabriquent-elles » une image ?

Midjourney, Dall-E et Stable Diffusion sont des IA génératives. À partir d’un simple prompt – une requête écrite détaillant le visuel attendu – ces logiciels sont capables de créer des visuels de toutes pièces en seulement quelques secondes.

Pour cela, ces IA se basent sur le machine learning. En s’entrainant à partir d’une base d’images conséquentes, l’IA apprend à reconnaître les liens entre un élément graphique et un texte, puis à reproduire ce lien de façon autonome. Pour chaque requête, l’IA tente de repérer des éléments dans sa base de données qui pourraient correspondre à ce qui lui est demandé puis génère un visuel en s’inspirant des images correspondantes.

Les IA « texte vers image » reposent sur une base de données dont l’origine demeure pour l’instant incertaine. Stable Diffusion se serait ainsi basé sur un total de 2,3 milliards d’images dont la majorité proviendrait de Pinterest, de sites de e-commerce, des sites WordPress.com ou encore de Flickr – soit des images potentiellement soumises au droit d’auteur.

Dès lors, ces « visuels » créés par les IA posent un certain nombre de questions. Dans un premier temps, à qui reviennent les droits d’auteur de ces visuels ? Pour l’instant, le flou est assez complet sur la question juridique et éthique et des discussions doivent avoir lieu avec le législateur.

En attendant, voici quelques astuces pour analyser les images et réussir à déterminer si une photographie a été générée par une IA ou si elle est bien réelle.

Observer les détails des images pour y déceler des incohérences

Avant toute chose, il est nécessaire d’analyser l’image dans ses moindres détails afin de potentiellement y déceler des incohérences. En effet, l’IA rencontre encore de grandes difficultés avec certaines parties du corps et avec la restitution des détails.

Analyser la structure des mains et des pieds, qui mettent l’IA en difficulté

L’intelligence artificielle est confrontée à une difficulté pour représenter les mains et les pieds. En effet, les logiciels ont tendance à créer trop de doigts et à déformer les proportions des phalanges, entre autres. Observer les mains et les pieds sur une image est donc généralement un bon moyen de détecter une image générée par une IA.

Le problème du nombre de doigts semble avoir été résolu (dans une certaine mesure) avec la version 5 de Midjourney, mais les proportions des phalanges ainsi que la position des doigts peuvent toujours être un indice. En analysant bien ces deux images, on peut constater une différence de taille et de grosseur entre les doigts de chaque main.

Il est également utile de regarder les articulations et proportions de certaines parties du corps, qui peuvent parfois donner un indice sur l’authenticité de la photographie.

Regarder la peau

La peau est l’un des éléments les plus complexes à reproduire. Les images générées par IA ont tendance à donner une apparence étrange à la peau, en particulier à celle du visage, qui tend à ressembler à de la cire ou du plastique, voire à un personnage de jeu vidéo.

Chercher l’erreur : les dents et les yeux

L’intelligence artificielle a tendance à être un peu généreuse sur les dents et à créer des sourires suspects, qui comporte beaucoup plus que 32 dents. Les yeux quant à eux tendent à être un peu trop écartés, trop blancs, parfois sans pupille ou trop brillants.

Analyser les textures

Les textures des tissus et des cheveux sont également peu naturelles lorsqu’une image est générée par une IA. Les vêtements sont trop brillants, les tissus semblent patinés et paraissent synthétiques, comme si l’image était passée par un traitement de réduction de bruit un peu trop violent. Le grain de l’image est particulier, loin de celui d’une photographie – et parfois plus proche de celui d’un jeu vidéo. C’est d’autant plus vrai avec les images générées par Midjourney.

Chercher du texte : l’IA a du mal à générer quelque chose de plausible

Dans le doute, chercher des éléments de texte dans l’image permet toujours de trouver des indices cruciaux. Les blasons, les slogans, les banderoles en arrière-plan ou encore les brassards : chacun de ces éléments est généré par l’intelligence artificielle grâce à des lettres et des symboles disposés de façon aléatoire.

Sur cette image, on remarque ainsi qu’aucun mot n’est cohérent, que ce soit sur les affichages en PLV ou sur le polo de Harry. Cela permet de décrédibiliser rapidement cette photo du couple Meghan et Harry ayant pris un peu de poids, se promenant dans les allées d’un supermarché américain.

Chercher dans le détail : les objets du quotidien

Si l’intelligence artificielle est capable d’illustrer des scénarios complètement imaginaires, il semblerait qu’elle invente également des objets en tout genre qui peuvent attirer l’attention des publics les plus avertis. En effet, les chapeaux, accessoires, téléphones portables, appareils photo et caméras sont souvent sujets à des déformations. Chercher ce genre de détails dans les photographies peut donc devenir un réflexe payant.

L’importance du décor dans une photo

L’arrière plan grouille souvent d’indices lorsqu’une image est générée par IA. En observant les coins, les zones de flous et les décors, vous pourriez découvrir des éléments irréalistes.

Observer l’architecture

L’IA générative semble avoir du mal avec les motifs répétitifs. Certains bâtiments voient ainsi leur architecture totalement déformée. Lorsqu’il s’agit de monuments connus, une simple recherche Google permet de comparer les images du bâtiment pour découvrir les incohérences.

Sur cette image surréaliste montrant le Pape de dos, les colonnes ne sont absolument pas alignées, ce qui ne ressemble en aucun cas à l’architecture du Vatican. Bien sûr, l’apparition d’une soucoupe volante devant le Pape suffit à lever le doute – mais dans bien d’autres cas, il est moins facile de discerner le vrai du faux.

Certains décors basiques comme un immeuble ou une rue peuvent également comporter des défauts facilement observables. Les fenêtres, les pierres d’un bâtiment, les poteaux, les vitres, ou encore les marches peuvent ne pas être alignés, et ainsi permettre d’identifier une image retouchée ou générée par une IA.

Observer l’arrière-plan et les décors

Plus l’image comporte d’informations, notamment avec les représentations de foule, plus l’IA commet des erreurs cruciales en arrière-plan. Il est donc nécessaire de chercher dans les détails, dans les zones de flou et dans les recoins de l’image. Certaines incohérences surgiront, comme des mains non rattachées à un corps ou bien des personnes déformées, parfois sans visages ou sans nez.

Sur cette image, on peut observer deux gants blancs qui semblent n’appartenir à aucune des femmes ainsi que deux paires de lunettes complètement déformées.

Ici, la mise au point est faite sur les jeunes femmes au premier plan, ce qui permet – au premier abord – de croire à une véritable photographie. Mais encore une fois, il est nécessaire de ne plus se contenter d’un bref coup d’œil à une image pour y croire.

En analysant les zones de flou dans l’image ci-dessous, on se rend compte que l’homme en arrière-plan a des jambes totalement déformées, beaucoup trop fines par rapport au reste de son corps, et que son bras gauche est plus maigre que son bras droit. En revanche, force est de reconnaître que le portrait de cette personne (fictive) est très photoréaliste.

Opter pour un regard photographique

Lorsque vous regardez une image, il est toujours intéressant de vous interroger sur sa conception. Comment la photographie a été réalisée, composée et comment vous pourriez potentiellement la reproduire ? En regardant les images avec un esprit de photographe, vous pourrez plus facilement détecter les clichés irréels.

Prêter attention à la perspective

Analysez les différents plans et la composition des images. Vous vous rendrez compte que l’intelligence artificielle est incapable de réalisme en ce qui concerne la perspective et les points de vue. Sur cette image par exemple, on peut vite remarquer la présence de la Tour Eiffel, qui semble posée sur la route – un point de vue totalement irréaliste si l’on jette un rapide coup d’oeil à la disposition des rues sur une carte. En outre, on observe une énorme différence de saturation des couleurs entre le premier et le second plan (voir point suivant).

Observer les couleurs

Les couleurs de l’image vont-elles ensembles ? Le niveau d’exposition, de contrastes, de saturation est-il homogène ? Analyser ces informations peut vous permettre de relever des incohérences entre les éléments d’une image. L’IA générative dispose d’une grande base de données, dont elle va s’inspirer afin de créer des visuels. Elle marie ainsi des styles complètement différents, sans idée de ce qui peut paraître réaliste ou non. Cela se traduit parfois par des couleurs qui ne vont pas ensemble sur une même image, et qui ne paraissent pas réalistes par rapport au contexte de l’image.

Ici par exemple, la netteté du chien et de son ballon ne correspond pas à celle de l’arrière plan. La différence de saturation entre le ciel et les couleurs du premier plan n’aurait également pas pu être obtenu avec un appareil photo.

Analyser le style photographique

De la même manière que l’IA ne parvient pas à créer un rendu réaliste et uniforme vis à vis des couleurs d’une image, il lui arrive également de mélanger les styles photographiques. Certaines différences de style, de saturation, de grain ou de couleurs peuvent donner une impression de collage à une image. Mettre votre regard photographique au service de vos analyses peut ainsi vous permettre de détecter plus facilement les fausses photographies.

Les outils de détection d’images générées par IA

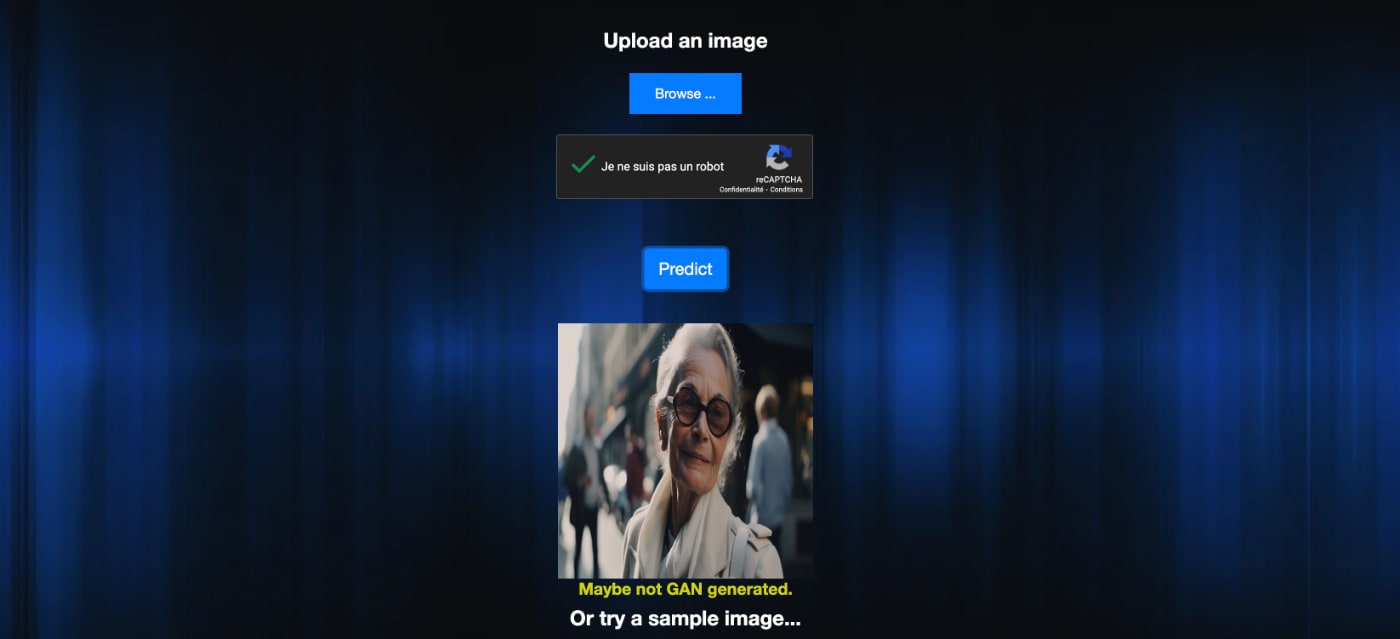

Certains outils permettent d’évaluer la probabilité qu’une image ait été créée par une IA. Gan Detector est un outil gratuit et en ligne, qui a le bénéfice d’être facile d’utilisation. En moins d’une seconde, la plateforme indique son résultat : « Maybe GAN generated » ou « Maybe not GAN generated » (GAN signifiant generative adversarial network ou réseau adverse génératif, précédé qu’utilisent les différentes IA pour générer un visuel).

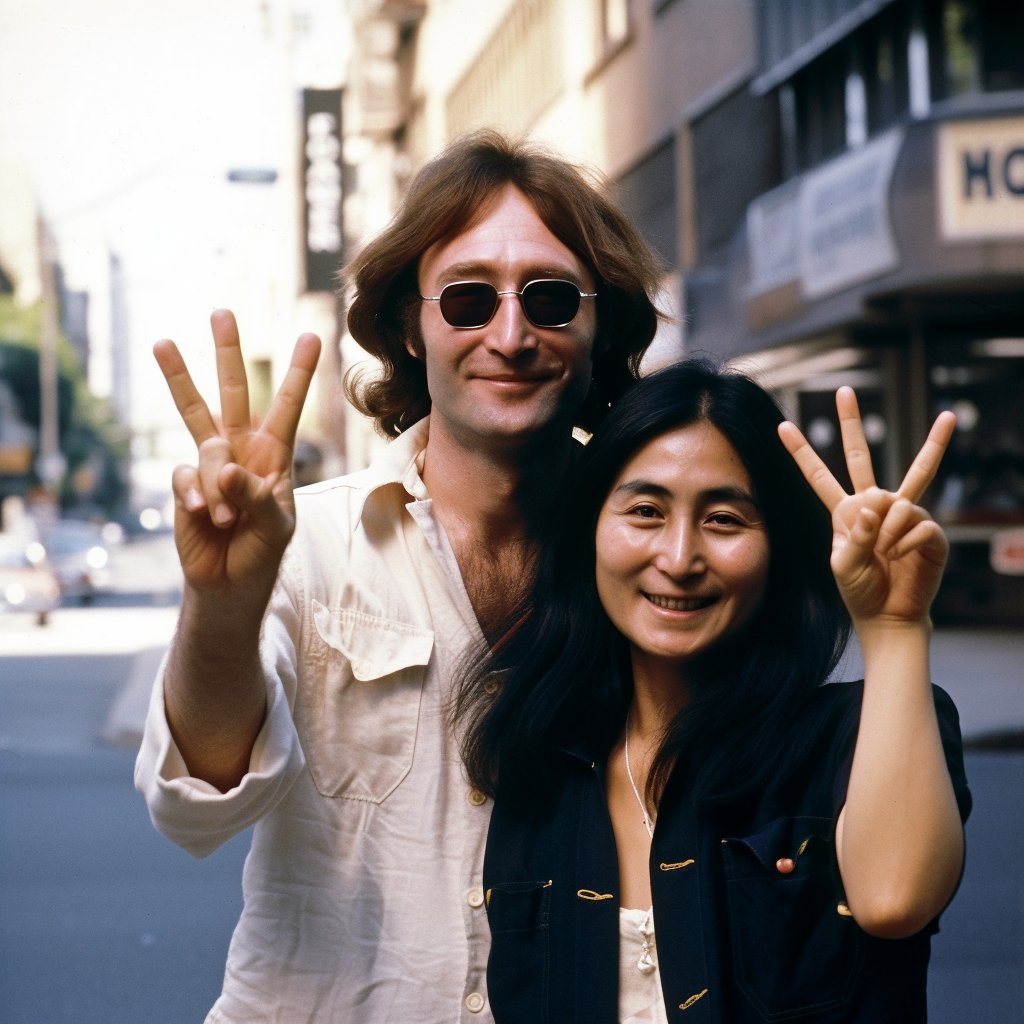

Ici, la plateforme indique que l’image a probablement été générée par un GAN. En effet, celle-ci a été faite sur Midjourney, chose que quiconque aurait pu deviner puisque John Lennon et Yoko Ono ont chacun un doigt en trop.

Cependant, le logiciel ne semble pas avoir progressé aussi vite que l’intelligence artificielle et ne parvient pas à détecter toutes les fausses photographies. Ici, la plateforme indique que l’image n’a probablement pas été générée par un GAN, alors qu’elle a été créée sur Midjourney.

Il est donc essentiel de savoir vérifier par soi-même l’authenticité d’une photographie – et donc d’être capable de l’analyser. Pour cela, n’oubliez pas de vous questionner sur son origine et sur la façon dont celle-ci a pu être générée.

Mise à jour : Gan Detector n’est à ce jour plus disponible, ce qui est certainement dû à son manque d’efficacité. Il existe cependant d’autres logiciels similaires tels que AI Image Detector, qui parvient à détecter plus régulièrement les images générées par IA, même s’il commet encore énormément d’erreurs.

Midjourney, Dall-E, Stable Diffusion : ne plus simplement croire ce que l’on voit

Par principe, le fact checking devrait être un réflexe dès que l’on reçoit une information, notamment sur les réseaux sociaux. Mais, désormais, cette nécessité vaut aussi pour les images, qui avec Photoshop, les deep fake et aujourd’hui l’IA ne nous permettent plus de simplement « croire ce que l’on voit ».

Chercher un éventuel crédit photo ou des métadonnées

Lorsque vous regardez une image, questionnez vous systématiquement sur son contexte. Par qui a t’elle été créée, quand et par quel moyen ? Pour savoir tout cela, n’oubliez pas de toujours chercher une éventuelle légende, un crédit photo et de chercher une potentielle légitimité chez le créateur. Est-il journaliste, photographe ? Ces données peuvent être indiquées dans le média, et si celles-ci ne le sont pas, elles seront très probablement mentionnées dans les métadonnées d’une image. La présence de données techniques dans les EXIFS comme la vitesse d’ouverture, la focale, ou l’appareil photo utilisé permet également de savoir que l’image a été générée par un appareil photo.

Malheureusement, les images partagées sur les réseaux sociaux voient leur métadonnées supprimées automatiquement. C’est pourquoi certains entreprises comme Nikon, Adobe ou encore le New York Times se sont réunis afin de créer la Content Authenticity Initiative, qui pousserait les réseaux sociaux à conserver les métadonnées telles que les appareils et logiciels utilisés ou les potentielles modifications apportées à l’image.

Mais en attendant, face à une absence de métadonnées pour une image, une recherche inversée pour retrouver l’origine de l’image peut être nécessaire.

Prendre le contrepied des progrès technologiques : les outils de recherche inversée

Le détournement d’image n’est pas né avec l’IA ni avec les réseaux sociaux, et était déjà très répandu lors des campagnes de propagandes au 20e siècle. Mais aujourd’hui, le danger est d’autant plus présent que la manipulation de l’information est à la portée de tous. Aussi, la sensibilisation à ce sujet est d’autant plus nécessaire et le processus de vérification de l’information – qu’elle soit écrite ou visuelle – reste essentiel.

Pour la plupart des cas, l’information transmise par une image peut être démentie en une rapide recherche Google. Parfois, l’image s’avèrera être complètement fausse, issue d’un photomontage ou générée par une IA. Dans ce cas vous constaterez qu‘aucun média traditionnel ne reprend l’information – ou alors justement dans un sujet de fact checking. Si l’on prend la fameuse image de Donald Trump arrêté par des policiers, il suffit de faire une recherche « Donald Trump arrêté » pour voir qu’aucun média traditionnel n’a traité du sujet.

TinEye

Le logiciel TinEye, lui, propose d’effectuer une recherche inversée. Il vous suffit de glisser votre image ou de copier le lien de celle-ci dans TinEye. Le logiciel donne ensuite les occurrences de votre image sur Internet – une façon d’obtenir plus de contexte sur celle-ci.

Malheureusement, TinEye possède ses failles. En effet, certaines images virales ne semblent par remonter, comme pour cette image d’Emmanuel Macron générée par Midjourney.

La recherche inversée via Google Images

La recherche inversée grâce à Google Images reste probablement la solution la plus efficace pour retrouver l’origine d’une image – ou du moins pour obtenir plus d’informations et de contexte autour de celle-ci.

Pour cela il suffit de cliquer sur l’appareil photo à droite de la barre de recherche Google et de glisser votre image. Le moteur de recherche ressort alors tous les résultats contenant votre image, que ce soit sur des sites de particuliers, de professionnels, des médias ou encore Twitter. Si l’image ne ressort dans aucun média traditionnel ou si elle n’apparait que sur Twitter, il s’agit très probablement d’une « fausse » photo.

Réfléchir au-delà de l’image

Un élément majeur à prendre en compte est la probabilité du scénario. Une photographie du pape en train de fumer un cigare ou portant une doudoune Balenciaga semble fortement improbable et suggère très rapidement l’utilisation de l’IA.

Le risque de désinformation se situe alors dans les images vraisemblables, telles cette photographie d’un homme blessé lors d’une manifestation, ou une rencontre improbable entre personnages politiques.

Malheureusement, les IA génératives semblent progresser à un tel rythme que les « artefacts » commis par ces logiciels n’existeront bientôt plus. Ces progrès affectent déjà les outils de vérification qui ne sont plus capables d’apporter un diagnostic correct.

Il sera donc de plus en plus compliqué de détecter si une photographie est réelle ou non. Ainsi, par principe, après avoir vu passer une image, que ce soit sur un événement d’actualité ou non, il devient de plus en plus nécessaire d’entamer des recherches sur le sujet dans des médias officiels, et non plus de simplement « croire ce que l’on voit ».