Potentielle arme de désinformation massive, les deep fakes permettent de produire des vidéos falsifiées souvent plus vraies que nature grâce à l’intelligence artificielle. Entreprises et chercheurs d’universités développent des solutions innovantes pour détecter ce procédé qui prend de plus en plus d’ampleur sur le web et les réseaux sociaux.

Le photomontage, le détourage et autres manœuvres de détournement utilisés à des fins de propagande sont célèbres dans l’histoire des arts visuels. Mais l’art de la falsification connaît depuis quelques années un essor sans précédent avec les nouvelles technologies du numérique et la technique des deep fakes qui consiste à créer des vidéos truquées parfois très réalistes.

À titre d’exemple, le web a vu circuler des vidéos dans lesquelles Jim Carrey remplace Jack Nicholson dans certaines scènes fameuses du film Shining ou encore des discours truqués de Mark Zuckerberg où il fait l’apologie de la société de surveillance. Autre exemple célèbre, Samsung et l’institut des sciences de Skolkovo sont parvenus à faire revivre Marylin Monroe en s’appuyant sur des échantillons d’images d’expressions animées de personnes ordinaires appliquées ensuite à une image fixe de l’actrice.

Samsung : une nouvelle IA permet d’animer des visages de manière ultra-réaliste

Si cette technique peut avoir des finalités divertissantes, elle peut toutefois se révéler dangereuse, induire en erreur et nuire à la réputation des individus.

L’intelligence artificielle pour traquer les deep fakes

Un nouveau pas a été franchi dans le monde de la recherche universitaire pour tenter de lutter contre ce phénomène et vérifier l’authenticité des images.

Pawel Korus et Nasir Memon, chercheurs de l’Université de New York Computer, ont eu l’idée de développer une technique directement intégrée à l’appareil photo et au smartphone. Ils ont conçu un réseau neuronal artificiel afin d’expérimenter un procédé qui permet de placer un fragment de code inaltérable et immuable au sein d’une photo ou d’une vidéo, et ce dès l’enregistrement de la photo sur la carte mémoire. L’intelligence artificielle introduit ainsi une sorte de signature numérique infalsifiable sans pour autant détériorer la qualité de l’image.

Ces fragments de codes sont extrêmement sensibles à l’altération, il serait donc difficile de modifier l’image sans les reconfigurer. D’après les deux chercheurs, il est possible de post-traiter une photo sans briser la signature numérique ; toutefois, une modification plus profonde viendrait casser le filigrane, indiquant directement que la photo originale a été altérée.

Ce réseau neuronal intégré permet ainsi de vérifier l’authenticité d’une photo ou d’une vidéo. D’après les tests effectués par les chercheurs, ce processus augmente de 45 à 90 % environ la capacité à détecter les images falsifiées. Si le système est capable de reconnaître une photo ou une vidéo truquée, il peut aussi indiquer précisément ce qui a été modifié, ce qui représente une avancée majeure dans le monde de la recherche.

Un standard d’authenticité des contenus

De grandes entreprises américaines ont également pris conscience de l’ampleur du phénomène des deep fakes et réfléchissent à des solutions pour lutter contre la prolifération de ces contenus trompeurs.

À l’occasion de l’Adobe Max 2019 en novembre dernier, aux côtés du New York Times et de Twitter, Adobe a présenté le Content Authenticity Initiative (CAI), un projet qui consiste à créer un outil de certification des contenus et système d’attribution des droits d’auteurs.

L’éditeur de logiciels en ligne souhaite concevoir un système qui rassemblerait toutes les informations liées aux contenus, permettant aux créateurs de certifier leur travail et aux utilisateurs de vérifier la provenance des photos et des informations. L’objectif : aider les internautes à remonter le fil des modifications apportées à un contenu jusqu’à la publication originale.

Un tel système a pour ambition de protéger le droit d’auteur en permettant de voir si le contenu a fait l’objet de modifications. Adobe a lancé un appel aux entreprises intéressées pour qu’elles puissent participer à la mise en œuvre de cette solution : chaque société pourra apporter ses connaissances afin d’affiner et perfectionner cet outil.

Pour Adobe, l’implication des entreprises de médias, des acteurs du web et des producteurs du web est absolument nécessaire pour restaurer la confiance des utilisateurs en ligne. Elles se doivent également d’encourager les internautes à faire preuve d’esprit critique face au potentiel de désinformation.

Adobe n’en est pas à son premier coup d’essai dans la lutte contre les contenus falsifiés. Depuis plusieurs années, l’entreprise se mobilise pour détecter les modifications apportées aux images. En juin dernier, elle a développé une intelligence artificielle pour identifier les images ayant été retouchées à l’aide de Photoshop.

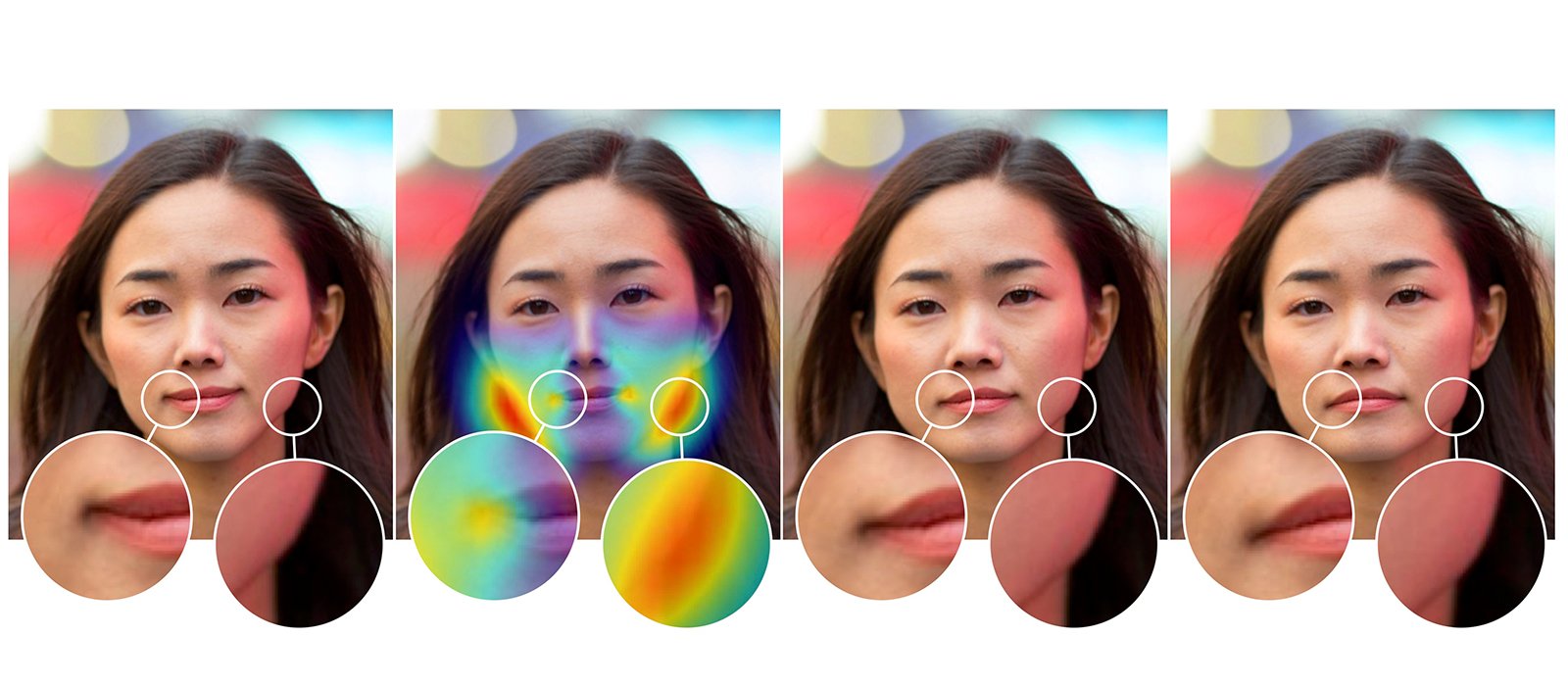

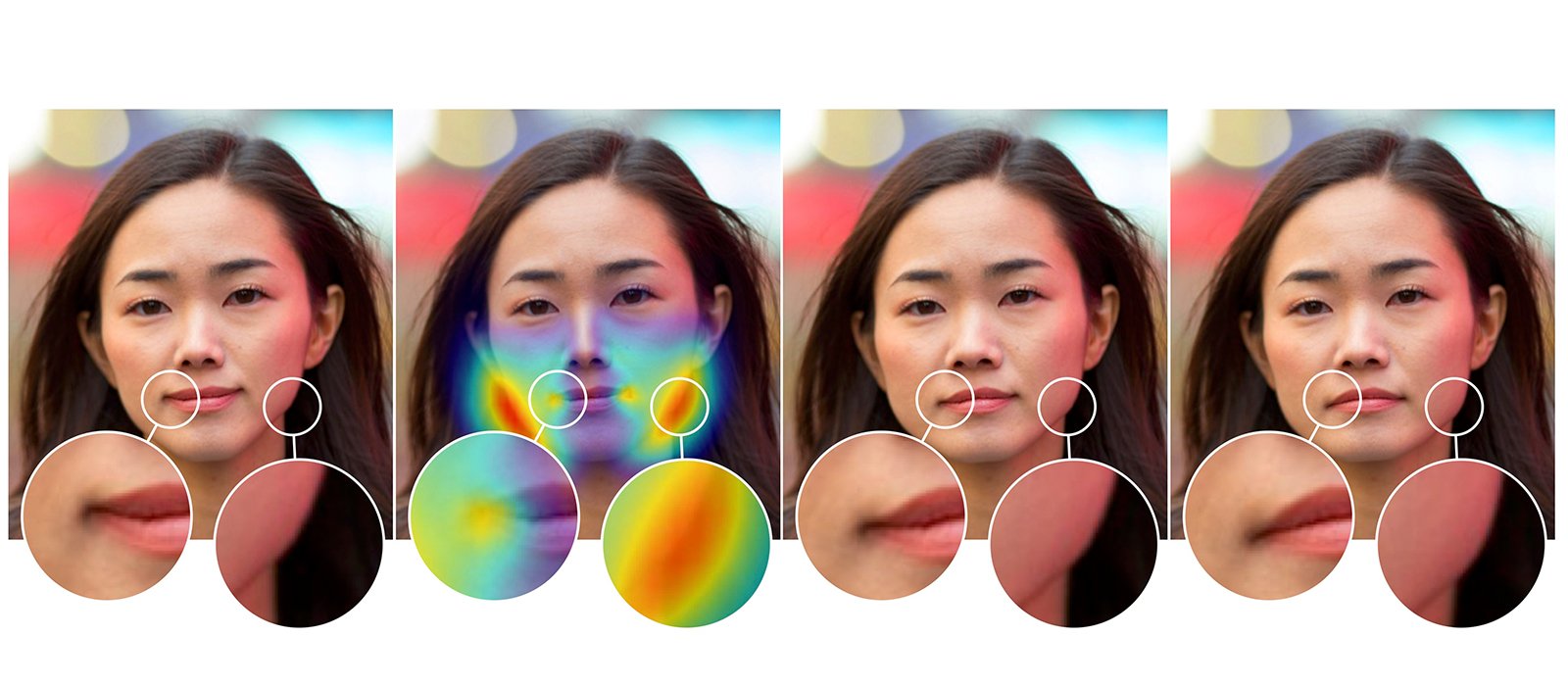

Une équipe de chercheurs a eu recours au deep learning pour entraîner un réseau neuronal en s’appuyant sur des milliers d’images modifiées. L’intelligence artificielle est ainsi capable de mesurer les modifications apportées à la photo mais aussi de restaurer l’image dans son état d’origine.

Former les algorithmes à la détection des deep fakes

En septembre dernier, Facebook a annoncé le lancement d’un concours : le Deepfake Detection Challenge, en partenariat avec Microsoft, Amazon Web Services et des chercheurs d’universités prestigieuses comme Oxford ou le MIT afin de créer une technologie capable de détecter plus rapidement les contenus truqués.

L’objectif : générer le plus de deep fakes possibles pour entraîner les algorithmes et concevoir à terme une solution innovante. Une banque de données et d’images, créées spécialement à cette occasion, sera à la disposition des participants pour accélérer la recherche afin de trouver un outil de détection performant et accessible à tous.

Acteurs du web et chercheurs du monde universitaire tendent à se rassembler pour multiplier les initiatives sur le terrain de la lutte contre les deep fakes. Mais dans un contexte où images et vidéos truquées fleurissent sur la toile, l’éducation et l’esprit critique des citoyens restent sans doute l’un des meilleurs remparts face au risque de manipulation.