Adobe et une équipe de chercheurs de l’université de Cornell (Etats-Unis) ont mis au point un algorithme qui permet de transposer le style visuel d’une image à une autre. Cette technologie fait penser à l’application Prisma, mais est cependant un procédé amélioré travaillant avec un peu plus de finesse pour plus de réalisme.

Afin de combiner deux photos en une, Adobe s’est inspiré du deep learning, une branche de l’intelligence artificielle et de l’apprentissage automatique. Cette technique très précise permet de capter les détails et les styles graphiques d’une photo, tels que sa lumière, ses nuances de couleurs, ses niveaux, et de les appliquer ensuite sur une autre image sans détruire sa structure.

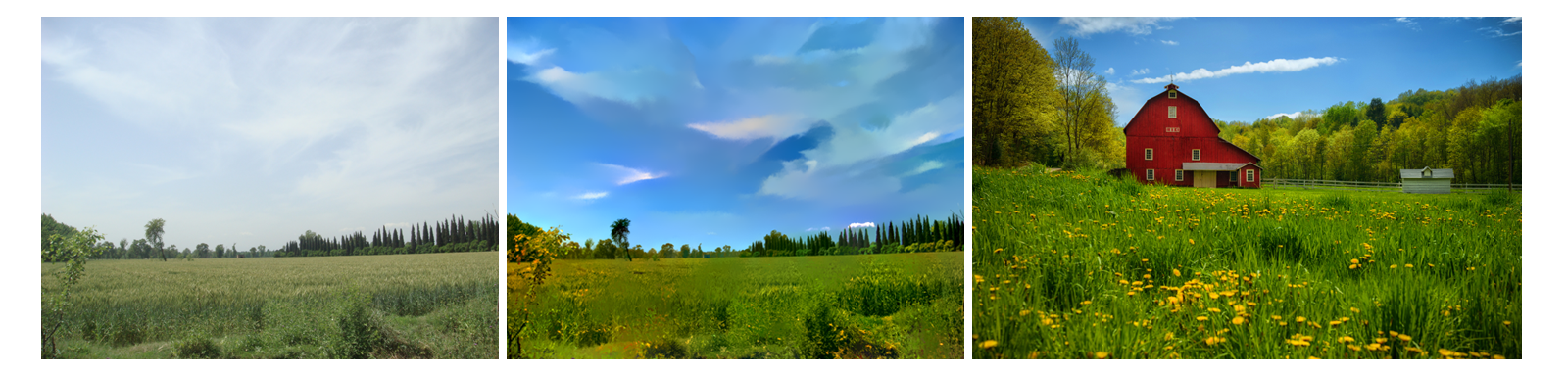

Ainsi, avec cette formule, il est possible, sur une photo, de passer du jour à la nuit, de changer les conditions météo et les saisons, et d’ajouter des effets artistiques (effet « Golden Hour » par exemple). Ce procédé s’est amélioré par rapport aux versions précédentes, permettant une transformation d’image plus réaliste, sans distorsion, sans superposition hasardeuse entre les deux images. Ainsi on évite que le beau ciel de la première image ne s’étende trop sur la seconde image où il est transposé.

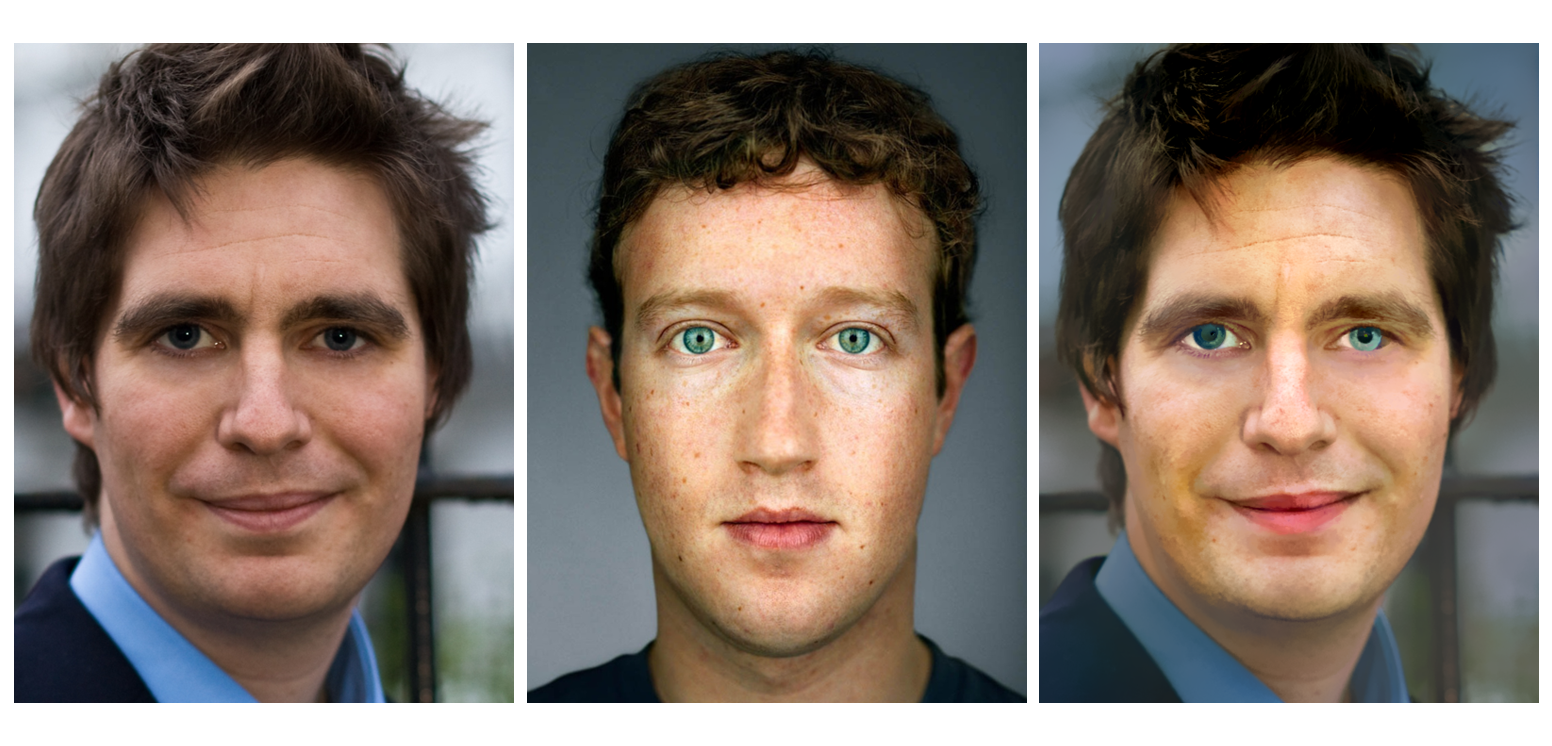

Mais il reste quelques limites au procédé. Le résultat final peut parfois manquer de réalisme, surtout quand il concerne des personnes, comme vous pouvez le voir avec l’exemple ci-dessous. Ce qui n’est pas plus mal, car la possibilité de transposer un visage sur un autre, et donc de modifier complètement l’identité d’une personne si finement, peut être effrayante.

Donc finalement cet algorithme fonctionne bien mieux quand les deux photos présentent des points communs (même sujet, même perspective, même angle…) et que ce sont des bâtiments ou des objets.

Toujours en cours d’élaboration, on ne sait pas encore si/quand cette fonction sera incluse dans Lightroom et/ou Photoshop. Mais les chercheurs ont partagé leur code en open source et des exemples de résultats sur GitHub.

Que pensez-vous de ce nouvel algorithme ?