Qui n’a jamais expérimenté le jeu du face swap avec un ami ? Bien connue des internautes et des adeptes de Snapchat, cette technique basée sur l’intelligence artificielle consiste à échanger son visage avec celui d’une autre personne. Un nouveau cap a été franchi par des chercheurs de l’université de Pékin et de Microsoft Research Asia, qui ont développé une technique plus aboutie, baptisée FaceShifter, offrant des résultats de meilleure qualité, d’un réalisme parfois troublant.

Le Face Swapping ou l’art d’échanger les traits de deux visages

Né il y a une vingtaine d’années avec Photoshop, le face swapping (littéralement « interversion de deux visages ») a connu un véritable essor grâce aux applications mobiles. Le face swap est ainsi devenu un filtre particulièrement populaire sur Snapchat aux alentours de 2016, permettant de générer des montages hilarants.

De la même manière, l’application Face Swap Live (disponible pour iOS et Android) permet de mélanger les visages de deux personnes en temps. Autre exemple, Zao, application la plus téléchargée en Chine en 2019, possède un ensemble d’algorithmes permettant de générer des vidéos « deepfakes » à partir d’une simple photo de l’utilisateur. De quoi remplacer le visage de l’acteur Leonardo di Caprio par sa propre frimousse en 8 secondes seulement dans certaines scènes de ses films les plus célèbres, comme le montre l’exemple ci-dessous.

In case you haven't heard, #ZAO is a Chinese app which completely blew up since Friday. Best application of 'Deepfake'-style AI facial replacement I've ever seen.

Here's an example of me as DiCaprio (generated in under 8 secs from that one photo in the thumbnail) 🤯 pic.twitter.com/1RpnJJ3wgT

— Allan Xia (@AllanXia) September 1, 2019

Autre exemple, vous pouvez aussi vous glisser dans la peau d’une célébrité grâce à Doublicat. L’application réalise des gifs personnalisés en remplaçant le visage d’une célébrité par le vôtre en s’appuyant sur un selfie réalisé par vos soins et une bibliothèque de mèmes de célébrités.

Des chercheurs développent aussi d’autres techniques qui pourraient à terme être appliquées en temps réel dans le domaine de la vidéo.

FaceShifter : la fusion ultra-réaliste de deux visages

S’il existe de nombreux outils pour intervertir les visages, le réalisme et la reproduction fidèle ne sont pas toujours au rendez-vous. Des chercheurs de l’université de Pékin et de Microsoft Research Asia ont conçu un outil plus perfectionné du nom de FaceShifter, qui vise à reproduire le plus fidèlement possible la forme et les expressions du visage.

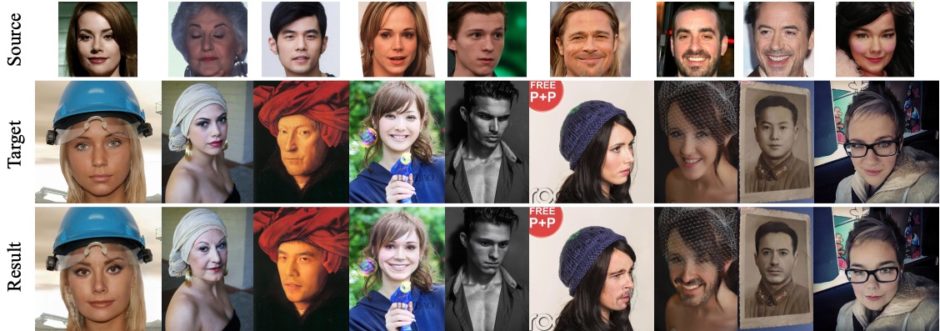

FaceShifter est un outil basé sur l’intelligence artificielle qui consiste à remplacer un visage par un autre en produisant un résultat réaliste. Il s’agit concrètement de transposer le visage d’une image source pour l’intégrer sur une image cible, en reprenant les caractéristiques du visage de ladite image cible, de la pose aux expressions faciales, en passant par la forme du visage, l’arrière-plan et l’éclairage. Le grand défi de ce montage consiste à extraire les informations des deux images et à les réorganiser pour produire un résultat suffisamment crédible et cohérent.

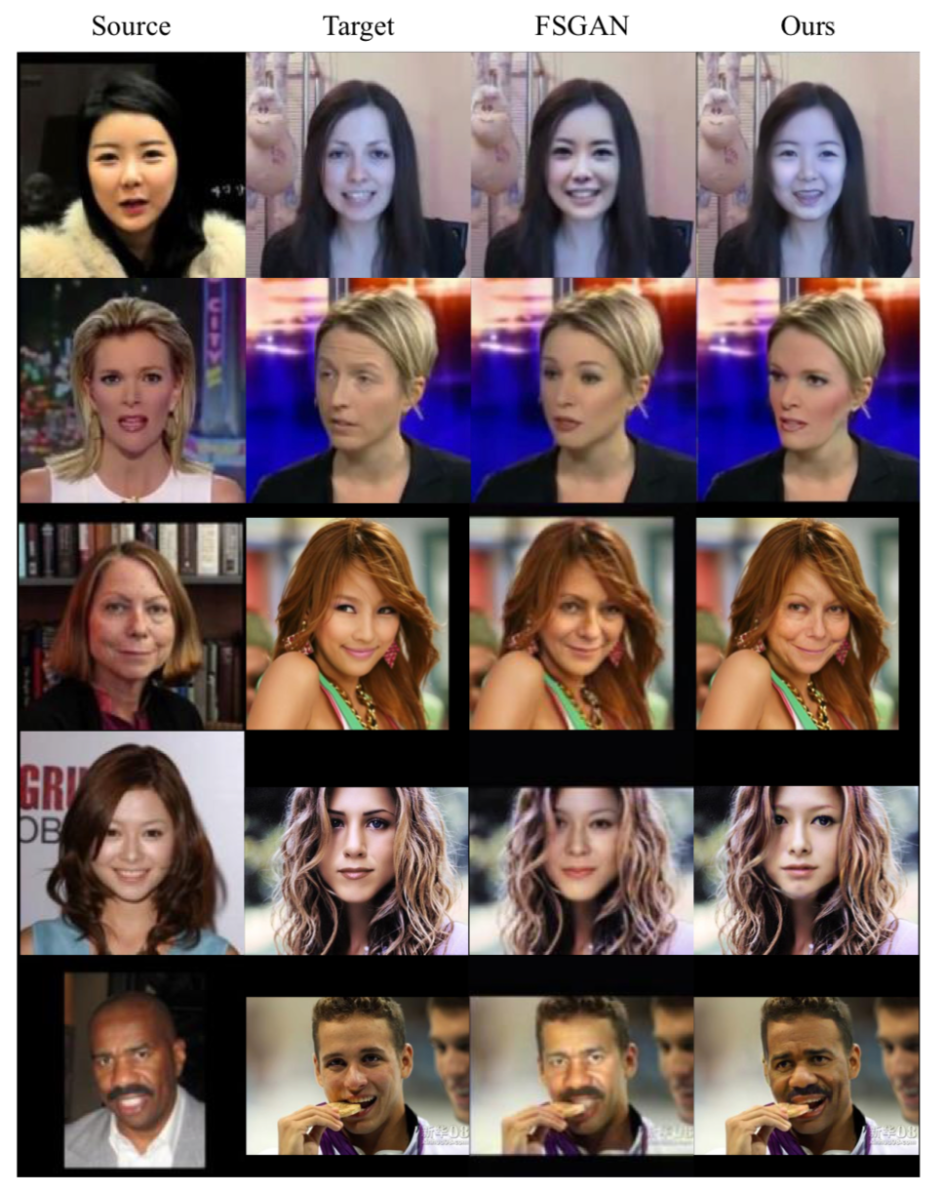

À l’inverse des autres méthodes existantes qui conservent moins d’éléments clés de l’image cible et produisent donc un visage moins naturel, FaceShifter préserve davantage de caractéristiques de la deuxième image pour obtenir un résultat beaucoup plus fidèle que les solutions existantes.

D’après les chercheurs, les autres outils d’échanges de visage rencontrent parfois des difficultés à représenter certaines expressions faciales complexes et certaines attitudes comme le fait d’avoir les yeux fermés.

Selon Microsoft Research, cet outil marque une grande avancée : il peut se contenter d’une seule image pour réaliser le montage, à l’inverse des autres applications qui peuvent nécessiter plus de données. À noter que la plupart des développeurs cherchent justement à réduire significativement le nombre d’images nécessaires à ce type d’opération tout en conservant un réalisme suffisant. La solution développée par les chercheurs marque donc un progrès conséquent.

Pour parvenir à ce résultat, ils se sont appuyés sur un mécanisme d’apprentissage automatisé (machine learning) couramment appelé GANs, pour « Generative Adversarial Networks« , reposant sur l’utilisation de deux réseaux fonctionnant en concurrence. Dans la pratique, le premier réseau (nommé « générateur » produit une image et la soumet au deuxième réseau (appelé discriminant). Entraîné au préalable avec la banque d’images Face Forensics ++, le réseau « discriminant » va indiquer au « générateur » les détails à modifier (au pixel près) afin d’améliorer le réalisme des images générées. L’utilisation de ce procédé n’est pas nouvelle, puisqu’on la retrouve également dans d’autres projets de recherche. Mentionnons ainsi les Talking Heads de Samsung (qui permettait d’animer le visage de Mona Lisa) ou le projet GauGan de Nvidia.

Samsung : une nouvelle IA permet d’animer des visages de manière ultra-réaliste

Par ailleurs, ce projet se démarque en ne nécessitant pas d’intervention humaine. L’intelligence artificielle serait également capable de reproduire des éléments complexes comme les lunettes, les ombres et les reflets sans qu’un humain n’ait besoin d’intervenir.

Si la capacité à reproduire des visages utilisée à de mauvaises fins peut susciter des craintes, cette technique de retouche offre aussi de nombreuses opportunités créatives au sein de nombreux secteurs comme le cinéma, les jeux vidéo, les arts visuels et graphiques.